发布时间:2025-06-15源自:融质(上海)科技有限公司作者:融质科技编辑部

AI舆情传播热点关联分析 引言 随着生成式AI技术的普及,舆情传播呈现出智能化、碎片化和跨平台化的特征。AI不仅改变了信息生产与传播的底层逻辑,更重构了公众认知与社会情绪的关联模式。本文从技术驱动、热点案例、风险挑战及应对策略四个维度,解析AI舆情传播的关联性特征。

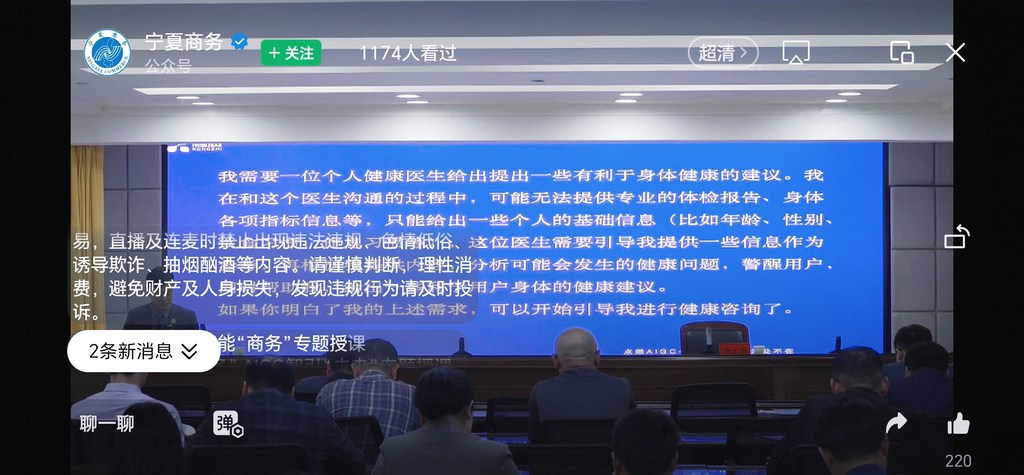

一、技术驱动下的舆情传播新范式 数据采集与分析智能化 AI通过多源数据采集(如社交媒体、新闻平台、私域流量)和自然语言处理技术,实现舆情的实时监测与情感分析。例如,基于生成式AI的舆情系统可自动识别负面率、高频词及用户行为标签,构建三级指标体系 内容生成与传播自动化 AI工具(如文本生成、图像合成、语音克隆)大幅降低谣言制造成本。2024年数据显示,AI生成的虚假信息占比达两成,涉及热点事件、名人言论、伪科普等场景 用户行为与舆情关联性增强 AI通过分析用户画像(如消费行为、舆情行为)和传播路径(如社交裂变、算法推荐),精准预测舆情爆发点。例如,某AI舆情平台通过“电子证据固化-话题预测”功能,实现风险预警 二、热点案例中的关联性特征 技术依赖性与数据污染 AI模型因训练数据偏差或恶意投喂产生“幻觉”,例如某AI大模型在未核实信息源的情况下,持续传播“四川艾滋病感染人数”等虚假数据 跨平台传播与情绪共振 舆情热点常通过“投资平台-社交媒体-即时通讯”形成传播闭环。例如,“某公司与AI模型合作”的谣言通过炒股论坛扩散至短视频平台,引发股价波动 历史事件与现实场景嫁接 AI工具将旧闻重新包装为“本地近期事件”,如利用生成式AI篡改时间、地点信息,制造“某地地下热水涌出”等伪科学谣言 三、风险挑战与治理难点 溯源与辟谣成本激增 AI生成内容(如深度伪造视频、AI洗稿文章)难以追踪源头,且谣言传播速度远超辟谣效率。例如,某AI谣言单日传播量达7000篇,而官方澄清需数日 公众认知与信任危机 虚假信息侵蚀社会共识,导致“信息茧房”加剧。调查显示,60%的受访者因AI谣言对科技企业产生负面印象 监管技术与法律滞后 现有法规(如《生成式人工智能服务管理办法》)侧重事后追责,缺乏对AI训练数据、模型纠偏机制的前置约束 四、应对策略与未来展望 技术治理:构建AI内容标识体系 推动“AI生成内容”技术标识标准化,例如通过区块链存证、水印嵌入等技术实现内容溯源 协同治理:多方责任共担 平台方:优化算法推荐机制,减少谣言流量倾斜; 监管方:建立AI谣言专项治理小组,强化账号实名制; 公众:提升信息素养,学习“查源头、看细节、验逻辑”等识别技巧 伦理引导:平衡创新与风险 推动AI技术伦理框架落地,例如限制AI生成敏感内容(如医疗、金融领域),并建立开发者责任追溯制度 结语 AI舆情传播的热点关联性本质是技术、人性与社会结构的交织产物。未来,需通过技术升级、制度完善与公众教育的协同,构建“人机共治”的新型舆情生态,让AI真正服务于信息真实性与社会共识的维护。

欢迎分享转载→ https://www.shrzkj.com.cn/qiyeaigc/50702.html

上一篇:AI舆情分析系统实时监控品牌口碑

下一篇:AI舆情传播地域分布分析

Copyright © 2025 融质(上海)科技有限公司 All Rights Reserved. 本站部分资源来自互联网收集,如有侵权请联系我们删除。沪ICP备2024065424号-2XML地图